- Linear Regression

"target" 이 하나가 아닌 경우 학습이 쉽지 않다.

- 모델 설정

- Model parameters (weights)

- Error

- Loss function(Cost function, Objective function)

- Object

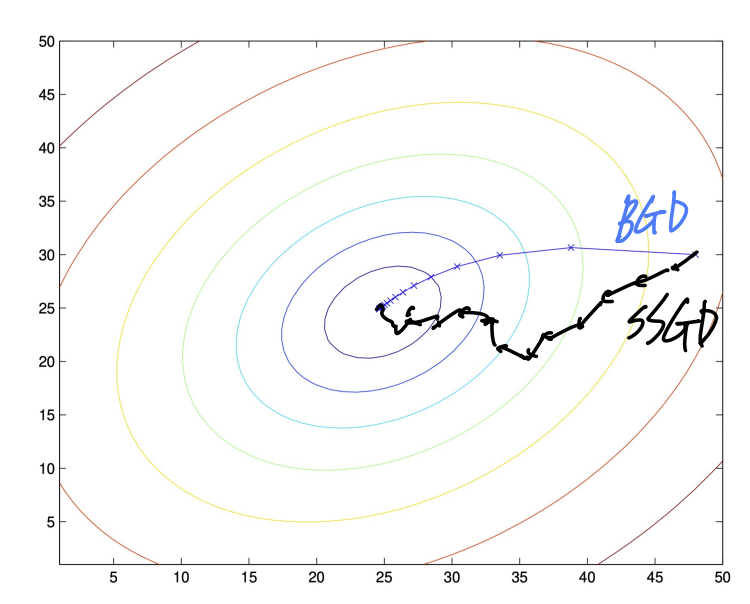

- Gradient Descent

- Loss surface

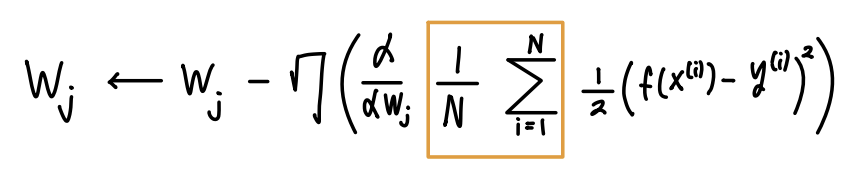

- Update Rule

- Learnable Parameters

W, 데이터 고정, model과 loss function도 정의되어 있음.

변하는 것 (학습해야 하는 대상)은 W다.

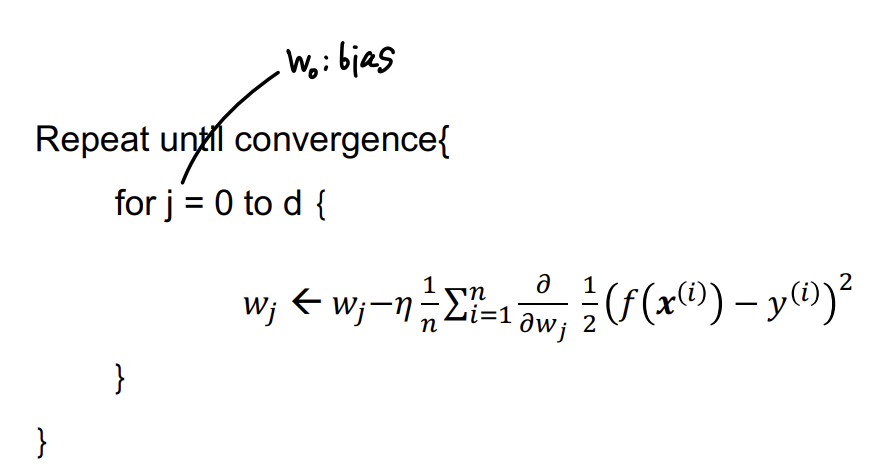

- Pseudo Code

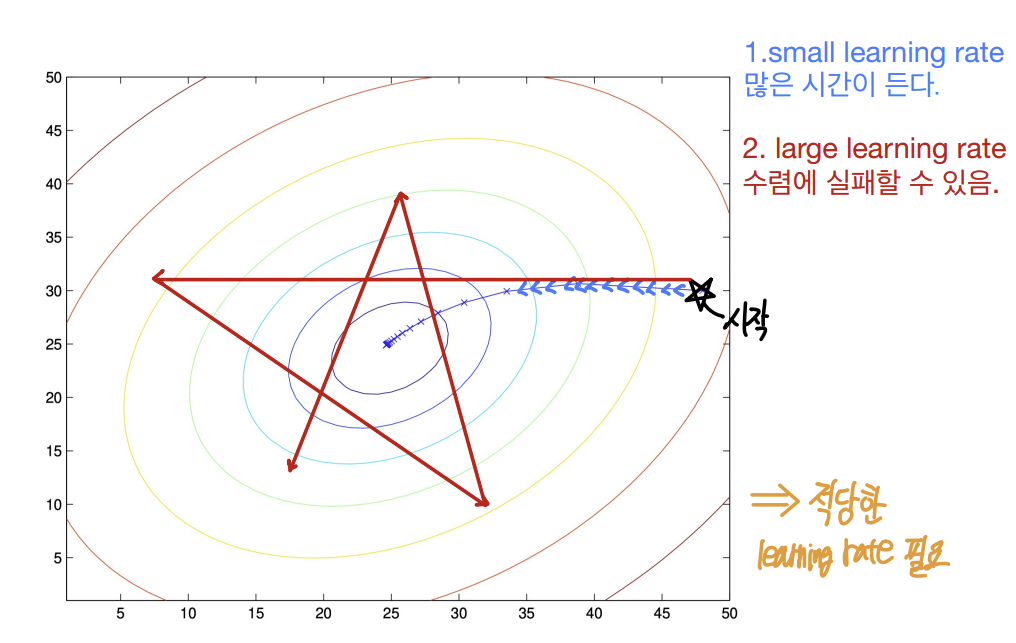

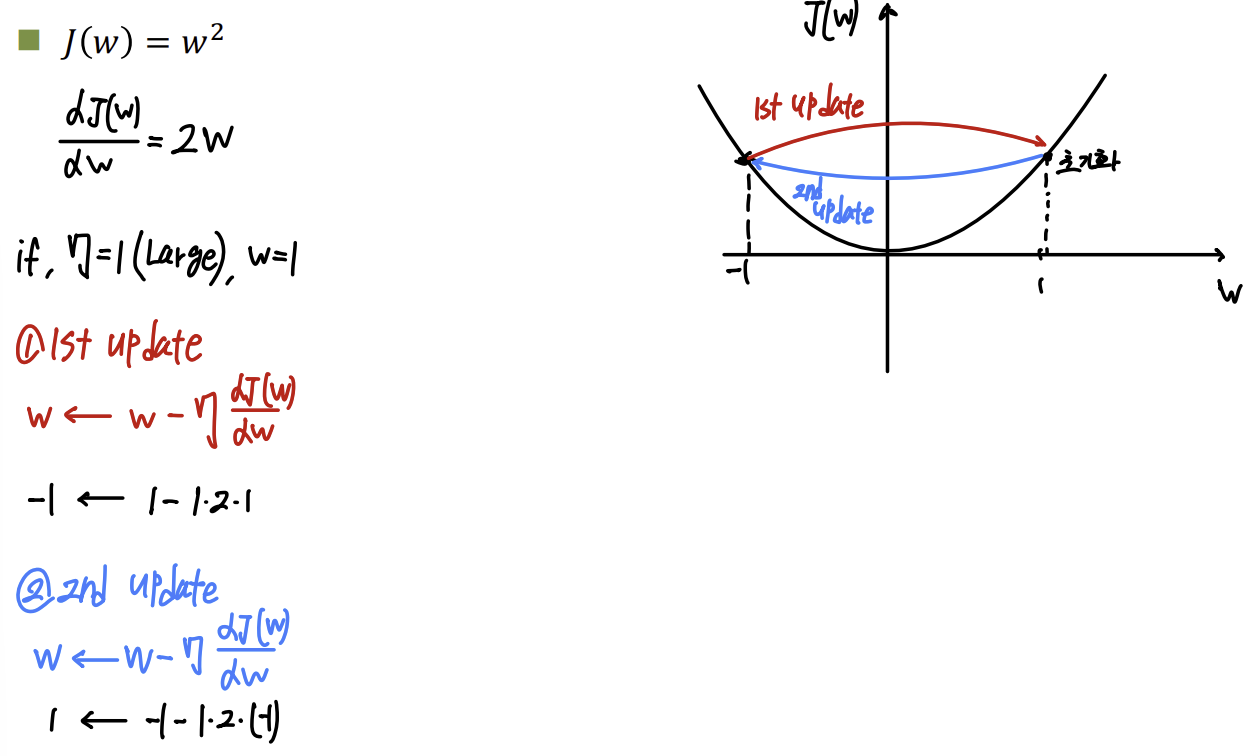

- Learning rate(lr)

1. Small Learning rate: 많은 시간이 든다.

2. Large Learning rate: 수렴에 실패할 수 있다.

=> 적당한 Learning rate 필요

- Small learning rate

- Large learning rate

- Epoch & iteration

- Epoch

전체 학습 데이터셋을 한 번 학습하는 과정. 즉, 모델이 주어진 데이터를 처음부터 끝까지 한 번 다 사용하여 학습하는 과정

- iterartion

미니 배치 하나에 대하 가중치가 한 번 업데이트되는 과정

- Batch Gradient Desent (BGD)

- Stochastic Gradient Desent(single instance) (sSGD)

- Stochastic Gradient Desent(mini batch) (mSGD)

'3-2 > 기계학습' 카테고리의 다른 글

| 7주차-Regularization (1) | 2024.10.27 |

|---|---|

| 6주차-Binary Classification (2) | 2024.10.27 |

| 5주차-Vectorization, Locally weighted regression (2) | 2024.10.09 |

| 4주차-Multiple features (1) | 2024.10.08 |

| 2주차-Dataset, 특징공간 (1) | 2024.09.17 |