- Batch Gradient Descent

- Stochastic Gradient Descent

- Linear Regression with Multiple features(input)

- Model parameters

w1~w4: 집 값을 예측하는데 각 feature가 기여하는 정도

=> 부호(+/-)는 비례/ 반비례 관계 설명

w0: 기본 가격

- Loss function

- Update rule

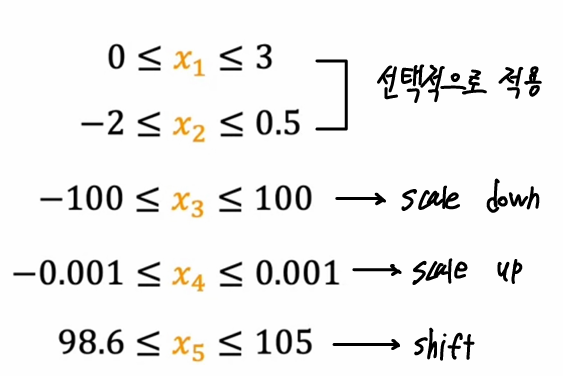

- Feature Scaling

Ex)

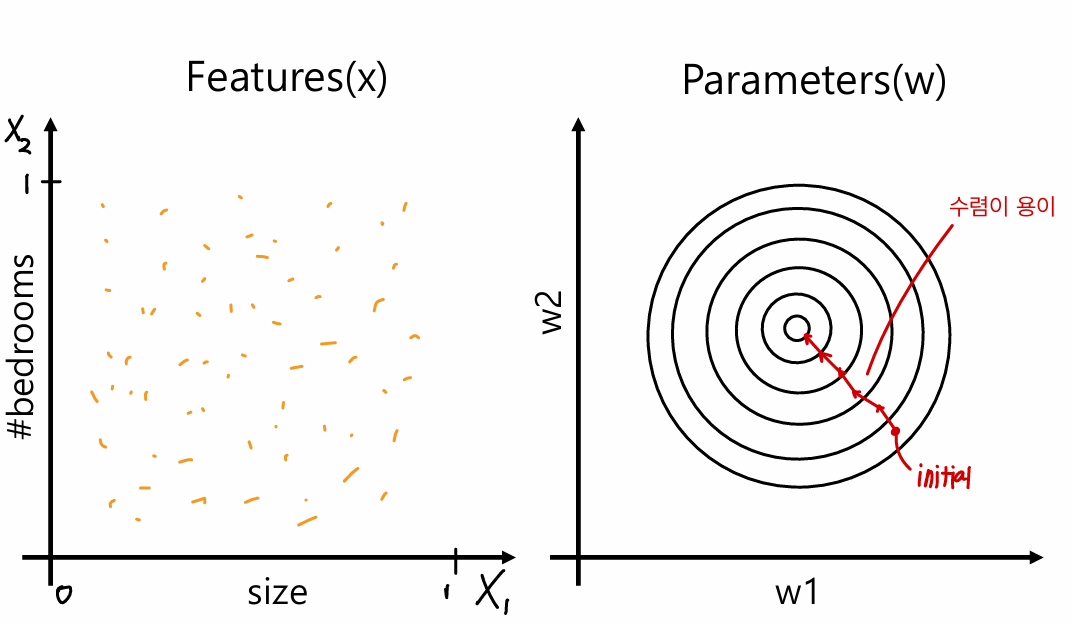

- Feature size and Gradient desent

- non-scaled faeature

- Scaled feature

- Scalers

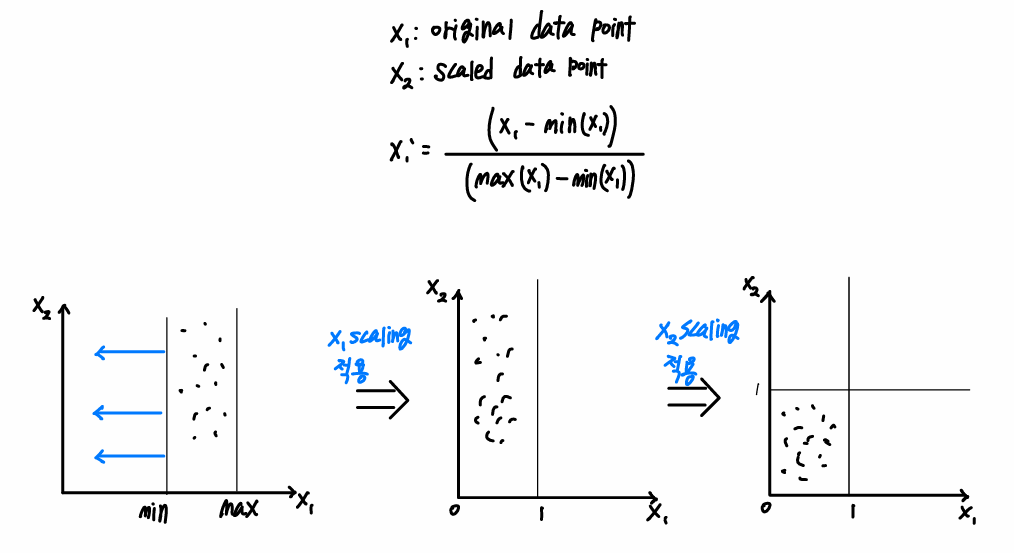

- MinMaxScaler

각 feture마다 적용

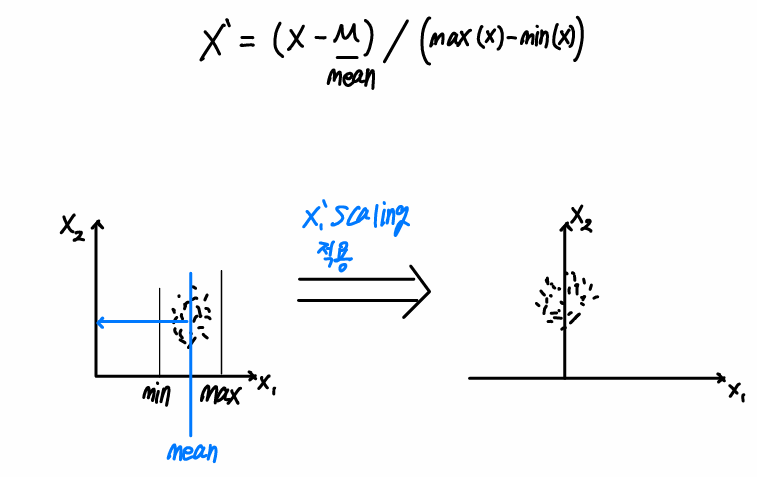

- Mean Sclaer

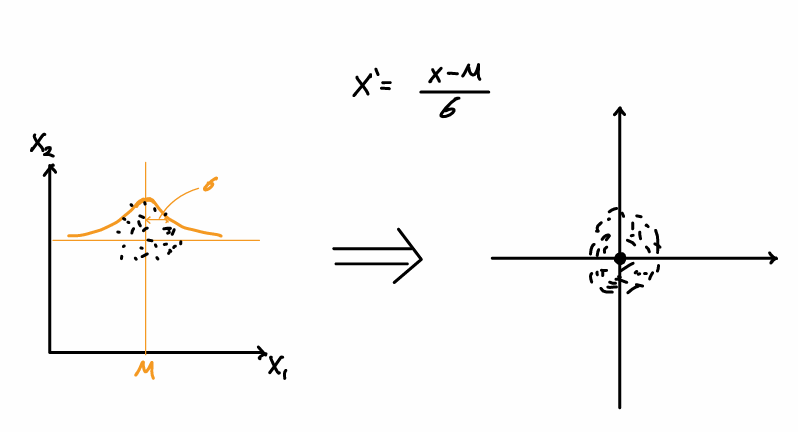

- Standard Scaler

EX)

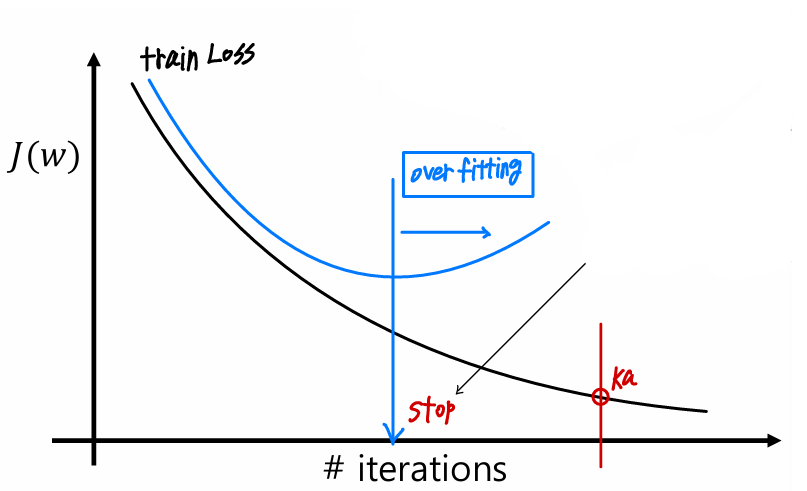

- Termination condition(종료 조건)

1. #iter을 미리 지정

2. ε (작은 값)을 정의, Loss의 변화량이 ε보다 작으면 STOP!

3. Validation set에 대한 Loss가 증가하기 직전 시점으로!

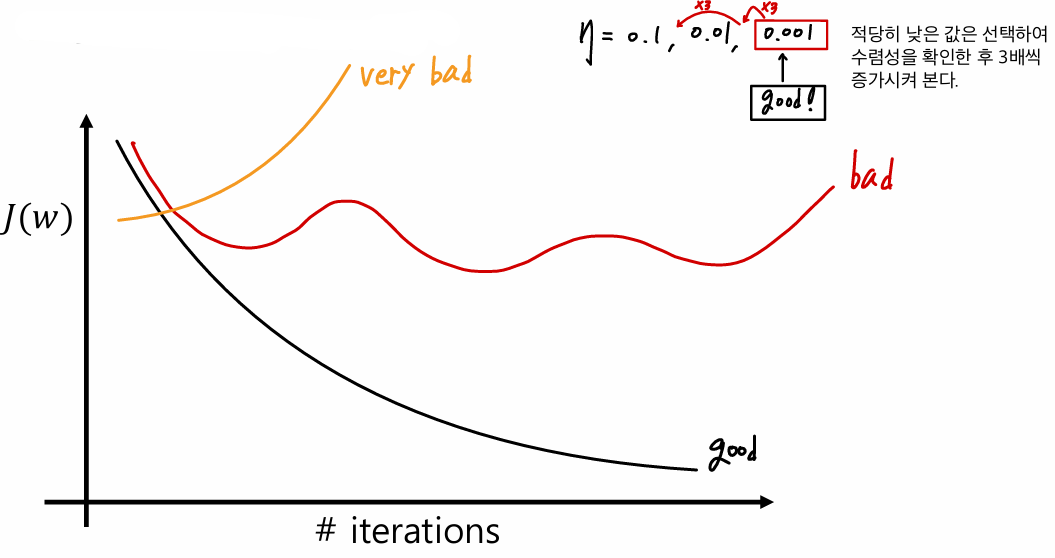

- Choosing the learning rate

'3-2 > 기계학습' 카테고리의 다른 글

| 7주차-Regularization (1) | 2024.10.27 |

|---|---|

| 6주차-Binary Classification (1) | 2024.10.27 |

| 5주차-Vectorization, Locally weighted regression (1) | 2024.10.09 |

| 3주차-Linear Regression, Gradient Descent (0) | 2024.09.29 |

| 2주차-Dataset, 특징공간 (1) | 2024.09.17 |